Reclutamiento cismático y objetivo, centrado en las habilidades e impulsado por la IA en STEM

¿Para IA o no para IA?

El uso de tecnologías de inteligencia artificial siempre ha sido propenso a acusaciones de posible sesgo debido a conjuntos de datos sesgados en los que se han entrenado grandes modelos lingüísticos. Pero seguro que las marcas se están asegurando de que esos prejuicios han sido ironizados, ¿no? Desafortunadamente, cuando se trata de IA y contratación, no todas las aplicaciones tecnológicas son iguales, por lo que las empresas deben actuar con cuidado. En otras palabras: si no lo entiende, no lo use.

Desde el lanzamiento de ChatGPT a finales de 2022, ha sido difícil leer un periódico, blog o revista sin alguna referencia a la extraña magia de la IA. Personas entusiastas y preocupadas por igual, y los reclutadores no son diferentes. Por cada beneficio que supone poder comprender y trabajar con grandes cantidades de información, parece haber aspectos negativos relacionados con el sesgo de los datos y los usos inapropiados.

Scismic es parte de la empresa más grande Digital Science y ambas han estado desarrollando soluciones centradas en IA durante muchos años. A partir de esa experiencia, entiendo que el desarrollo y la implementación responsables de la IA son cruciales no sólo porque es «lo correcto», sino porque simplemente garantiza que se creen mejores soluciones para los clientes. Clientes que a su vez pueden confiar en Digital Science y Scismic como socios durante un período de cambios tan rápidos e incertidumbre.

IA en foco

Los beneficios potenciales de utilizar la IA en la contratación son bastante claros. Con la IA generativa como ChatGPT, se pueden escanear e interpretar grandes cantidades de datos de forma rápida y sencilla, lo que potencialmente ahorra tiempo y dinero durante la detección. A su vez, el proceso de selección también se puede mejorar al seleccionar fácilmente palabras y frases clave en las solicitudes, mientras que las comunicaciones sobre el proceso de contratación se pueden mejorar utilizando herramientas automatizadas que funcionan con IA.

Pero, por supuesto, hay una desventaja. El uso excesivo de la IA parece eliminar lo «humano» de Recursos Humanos, y la IA en sí es tan buena como los datos con los que ha sido entrenada. Un problema clave con la IA en el reclutamiento fue resaltado en el reciente informe emitido por la Comisión de Igualdad de Oportunidades en el Empleo (EEOC) de EE. UU., que apoyó a una persona que afirmó que las herramientas de reclutamiento basadas en IA que un vendedor discriminaba contra él y otros. La EEOC ha presentado recientemente casos contra el uso de la tecnología, sugiriendo que otros proveedores además de los empleadores podrían ser considerados responsables por el uso indebido de la tecnología basada en IA.

¿Cuándo deberíamos utilizar la IA?

En general, si no lo entiende, no lo use. Surgen problemas tanto para los proveedores como para los reclutadores cuando se trata de adoptar herramientas de inteligencia artificial a escala. Si bien enormes conjuntos de datos ofrecen las ventajas expuestas anteriormente, también introducen sesgos más allá de los humanos con los que empleadores y empleados han estado enfrentando durante años. De hecho, en lugar de ensalzar las virtudes del uso de la IA, quizás sea más instructivo explicar cómo NO utilizar esta nueva y poderosa tecnología.

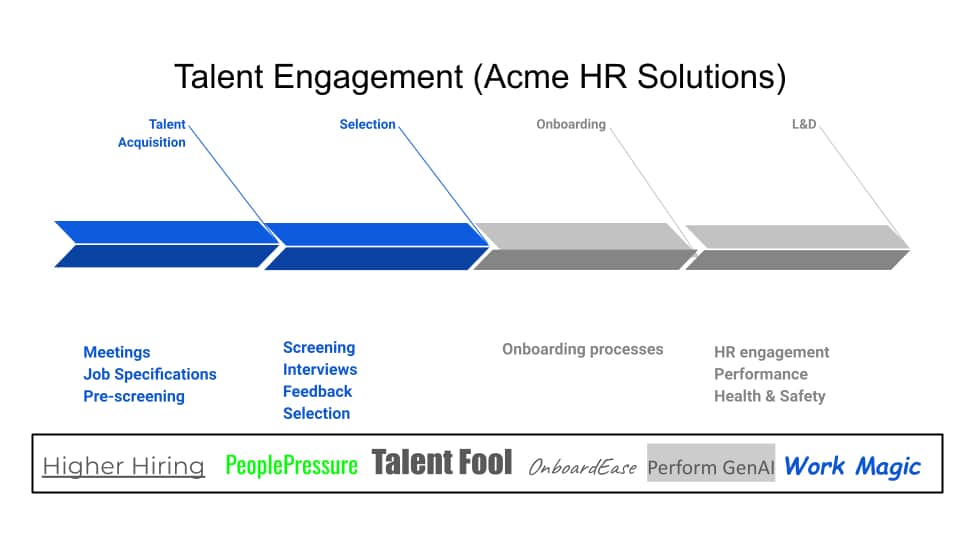

Como desarrollador responsable y ético de soluciones de contratación basadas en IA, los colegas de Scismic se sorprendieron al ver una diapositiva como la siguiente en un evento reciente. Si bien fue diseñado para demostrar a los empleadores las ventajas de la tecnología de reclutamiento basada en IA, en realidad resalta los peligros de «superponer» sistemas de IA uno encima del otro. Esto significa que la empresa cliente pierde aún más visibilidad sobre quién y cómo selecciona el sistema, lo que aumenta el riesgo de sesgo, de perder buenos candidatos y, en última instancia, el riesgo de un desafío legal.

En este escenario, con tantas tecnologías superpuestas a lo largo del flujo de trabajo, es casi imposible entender cómo se desarrolló la cartera de candidatos, dónde se excluyeron los candidatos y en qué puntos el sesgo causó más sesgo en el proceso de selección.

Si bien la lista de herramientas de IA utilizadas en el proceso es impresionante, lo que no lo es tanto desde la perspectiva de la contratación es la capa tras capa de posibles sesgos que estas herramientas pueden introducir en el proceso de contratación.

En Scismic ofrecen un enfoque diferente. La IA se utiliza para ELIMINAR sesgos en conjuntos de datos, de modo que todas las ventajas de utilizar procesos automatizados estén protegidas mediante la introducción de procesos mitigantes, garantizando así un programa de contratación más justo y ético para los empleadores.

¿Discriminación positiva?

La tecnología de Scismic se centra en unidades objetivas de calificaciones: habilidades. Usamos IA para reducir el sesgo de uso de terminología asociado con la descripción de habilidades. Ahora tenemos dos formas de reducir el sesgo de evaluación:

- Tecnología de emparejamiento ciego de candidatos que se basa en unidades objetivas de calificaciones: habilidades

- Terminología neutralizadora de los candidatos para describir sus habilidades.

¿Qué tipo de IA se está utilizando?

Para ayudar a explicar cómo Scismic hace esto, podemos dividir la IA en IA subjetiva (o generativa) como ChatGPT e IA objetiva. La IA subjetiva es, en general, un sistema contextual que hace suposiciones sobre qué proporcionar al usuario en función de las interacciones pasadas del usuario y su propia capacidad para utilizar el contexto. Este sistema puede funcionar bien para interacciones humanas (como ChatBots), que es para lo que fue diseñado.

Sin embargo, cuando se aplican a la toma de decisiones sobre personas y contratación (un área que ya está plagada de dificultades), los sistemas subjetivos y contextuales pueden simplemente reforzar los sesgos existentes o generar nuevos sesgos. Por ejemplo, si una empresa integra un producto GenAI en su Sistema de seguimiento de candidatos (ATS) y el sistema identifica que la mayoría de las personas en el sistema comparten una característica particular, entonces el sistema asumirá lo que es la empresa. Está claro que si la empresa realmente intenta ampliar su base de contratación, esto podría tener un efecto muy negativo, que también podría impugnarse ante los tribunales.

La IA objetiva funciona de manera diferente, ya que no analiza el contexto en torno a la instrucción dada, sino solo los componentes clave que se solicitaron. Esto significa que no hace suposiciones mientras acumula los resultados (datos) clave iniciales, pero puede proporcionar detalles más objetivos sobre el conjunto de datos. En muchos sentidos es un sistema «más limpio», pero como está enfocado y es transparente, es la mejor opción para eliminar sesgos involuntarios.

La IA es una herramienta y, como ocurre con tantos trabajos que requieren herramientas, la pregunta frecuente es: ¿Cuál es la mejor herramienta para usar? En resumen, recomendamos que una herramienta que produzca mejores resultados con menos sesgos sea la respuesta en un proceso de contratación.

Caso por caso

Para mostrar qué tan bien pueden resultar algunos casos cuando se utiliza la ‘IA objetiva’ de manera responsable y astuta, aquí hay tres estudios de caso que muestran cómo llegar a algunos resultados genuinamente positivos:

- La IA adecuada: con un cliente, se contrató a Scismic para presentar un grupo de talentos más diverso, ya que la empresa estaba formada en un 80 % por hombres blancos, y esos hombres blancos estaban contratando a más hombres blancos para unirse a ellos. Después de introducir la solución de contratación de Scismic, el porcentaje de solicitantes diversos en los primeros cinco puestos anunciados aumentó del 48 % al 76 %.

- El enfoque correcto: una persona que durante mucho tiempo tuvo la mala suerte de encontrar un nuevo puesto en las ciencias biológicas finalmente encontró trabajo a través de Scismic. ¿La razón? Tenía 60 años. Con un proceso de contratación basado en inteligencia artificial, su perfil podría haberse pasado por alto como un caso atípico debido a su edad si una empresa normalmente contratara a personas más jóvenes. Sin embargo, al eliminar este prejuicio, finalmente superó la edad (ya fuera inducida por la IA o por el hombre) y encontró un papel satisfactorio con un empleador muy agradecido.

- La entrevista correcta: otra posible contratación que recibe ayuda de Scismic es neurodivergente y, como resultado, parece tener dificultades para obtener buenos resultados en las entrevistas. Un escaneo basado en inteligencia artificial del historial de esta persona puede detectar una serie de entrevistas fallidas y, por lo tanto, señalarles diferentes roles o niveles de responsabilidad. Pero la falta de éxito no se debe necesariamente a esto, y es mucho más probable que la intervención humana facilite resultados positivos que utilizar la IA como atajo y diagnosticar erróneamente el problema.

¿Cuándo no utilizar la IA?

Un aspecto destacado en estos estudios de caso es que, si bien la IA puede ser importante, lo que puede ser igualmente importante es cuándo SÍ usarla y comprender que no es una panacea para todos los problemas de reclutamiento. Por ejemplo, no es apropiado utilizar IA cuando usted o su equipo no comprenden qué efecto tiene la intervención de la IA en su cartera de candidatos y en su proceso de selección.

Se puede encontrar ayuda para comprender cuándo y cuándo no usar la IA en muchas investigaciones nuevas, que muestran cómo la IA quizás se utilice mejor como un socio en el reclutamiento en lugar de como algo a cargo de todo el proceso o incluso de parte del proceso. Esta idea, conocida por algunos como «co-inteligencia», requiere mucho trabajo y desarrollo por parte del ser humano, y la clave para ello es contar con las estructuras adecuadas para que la IA y las personas trabajen en armonía.

Por ejemplo, los datos del mercado muestran que en las ciencias biológicas y los servicios médicos, la rotación de empleados supera el 20%, y en parte esto se debe a que no se cuenta con parte de la estructura y los procesos adecuados durante la contratación. El uso incorrecto de la IA puede aumentar el sesgo y llevar a contratar a personas equivocadas, aumentando así esta disrupción. Sin embargo, el uso de la IA de forma estructurada y justa quizás podría empezar a revertir esta tendencia.

Además, reducir el sesgo en el proceso de contratación no se trata solo de utilizar o no la IA; a veces se trata de garantizar que se optimice el elemento humano. Por ejemplo, investigaciones recientes muestran que las entrevistas bien estructuradas pueden reducir el sesgo de contratación y generar resultados mucho más positivos.

El reclutamiento conlleva responsabilidad

Está claro que la IA ofrece grandes oportunidades en el ámbito de la contratación tanto para empleados como para empleadores, pero esto conlleva importantes salvedades. Tanto para los reclutadores como para los proveedores, el foco en el desarrollo de nuevas soluciones debe ser cómo se pueden producir e implementar de manera responsable, ética y justa. Ésta debería ser la exigencia mínima de los empleadores y, sin duda, es la expectativa mínima de los empleados. La visión de que los lugares de trabajo se vuelvan más justos gracias a la adopción de soluciones de IA desarrolladas éticamente no sólo es atractiva, sino que está al alcance de todos. Pero sólo se puede lograr si el progreso de las últimas décadas en la implementación de prácticas de recursos humanos más justas no se pierde en la fiebre dorada de perseguir la IA. Como regla general, los reclutadores y socios de talento deben comprender estos componentes de las tecnologías que utilizan:

- ¿Cuál es la naturaleza del conjunto de datos del que aprende el modelo de IA?

- ¿Dónde están los posibles sesgos y cómo mitiga el vendedor estos riesgos?

- ¿Cómo toma el modelo la decisión de excluir a un candidato del proceso? ¿Y estás de acuerdo con esa premisa?

Comprender los pasos involucrados en la creación de esta estructura puede ser instructivo y será el tema central de nuestro próximo artículo, ‘Implementación de procesos estructurados de adquisición de talentos para reducir el sesgo en la evaluación de sus candidatos’. Mientras tanto, puede ponerse en contacto con Peter Craig-Cooper en Pedro@scismic.com para conocer más sobre nuestras soluciones.

Vea también nuestro anuncio: Centrarse en la economía basada en habilidades STEM para el nuevo director comercial de Scismic

Sobre el Autor

Simón Linacre, Responsable de Contenidos, Marca y Prensa | Ciencia Digital

Simon tiene 20 años de experiencia en comunicaciones académicas. Ha hablado y publicado sobre temas de bibliometría, ética editorial e impacto de la investigación, y recientemente es autor de un libro sobre publicaciones predatorias. Simon es tutor de ALPSP y también se ha desempeñado como administrador de COPE.